February 23, 2026

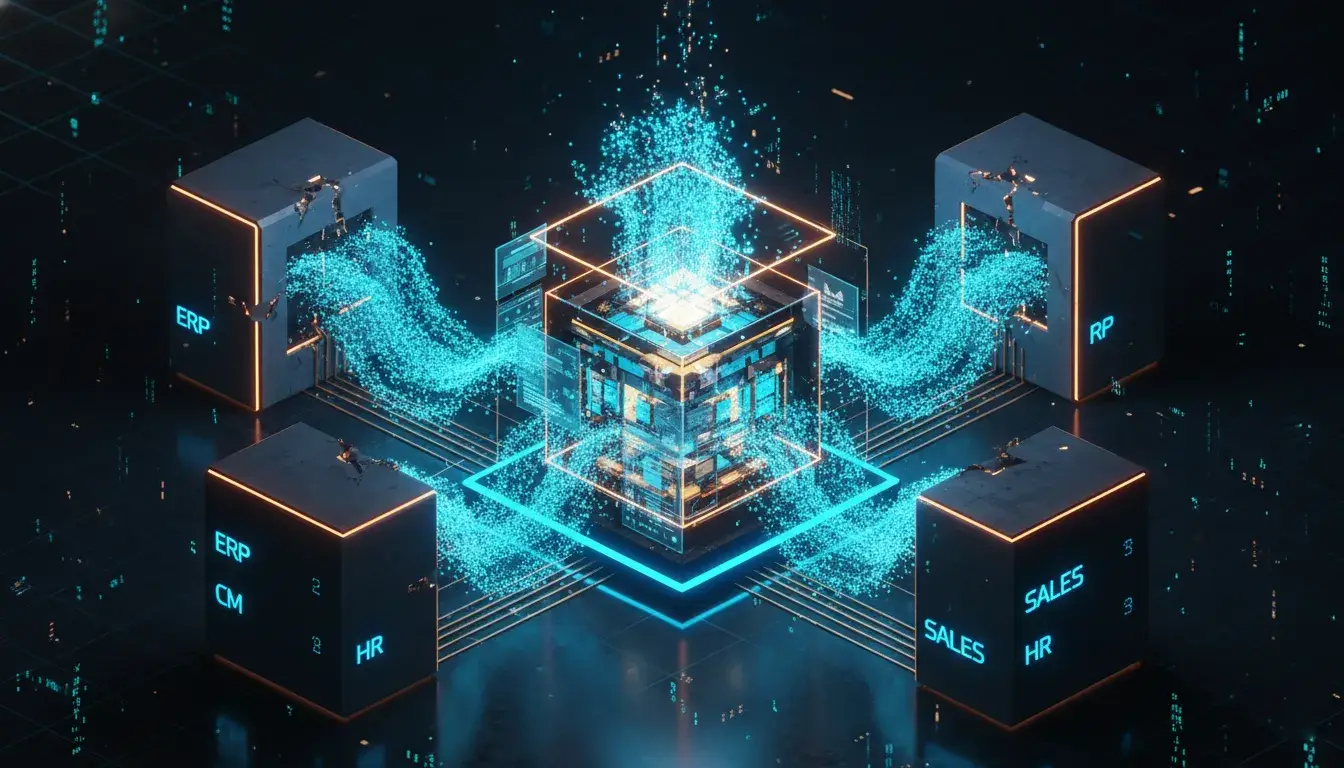

บ่อยครั้งที่ผู้บริหารตั้งโจทย์ว่า "เราต้องเอา Machine Learning มาวิเคราะห์พฤติกรรมลูกค้า" แต่เมื่อทีม Data Scientist เริ่มลงมือทำ กลับพบว่าข้อมูลการซื้อขายอยู่ในระบบ ERP รุ่นเก่า, ข้อมูลการติดต่อลูกค้าอยู่ใน CRM ของทีมเซลส์ และข้อมูลพฤติกรรมบนเว็บอยู่ในแพลตฟอร์ม Marketing... โดยที่ทุกระบบ "ไม่เคยเชื่อมต่อกันเลย"

การพยายามสร้าง AI บนโครงสร้างพื้นฐานที่แตกร้าว ก็เหมือนการสร้างตึกระฟ้าบนดินโคลน บทความนี้จะเจาะลึกถึงการวางรากฐาน data architecture for AI เพื่อเตรียมความพร้อมให้องค์กรก่อนก้าวเข้าสู่สมรภูมิ AI อย่างเต็มตัว

Data Silo คือภาวะที่ข้อมูลถูกขังแยกกันอยู่ตามแต่ละแผนก สิ่งนี้เปรียบเสมือน "ภาษีแฝง" (Hidden Tax) ที่กัดกินประสิทธิภาพขององค์กร:

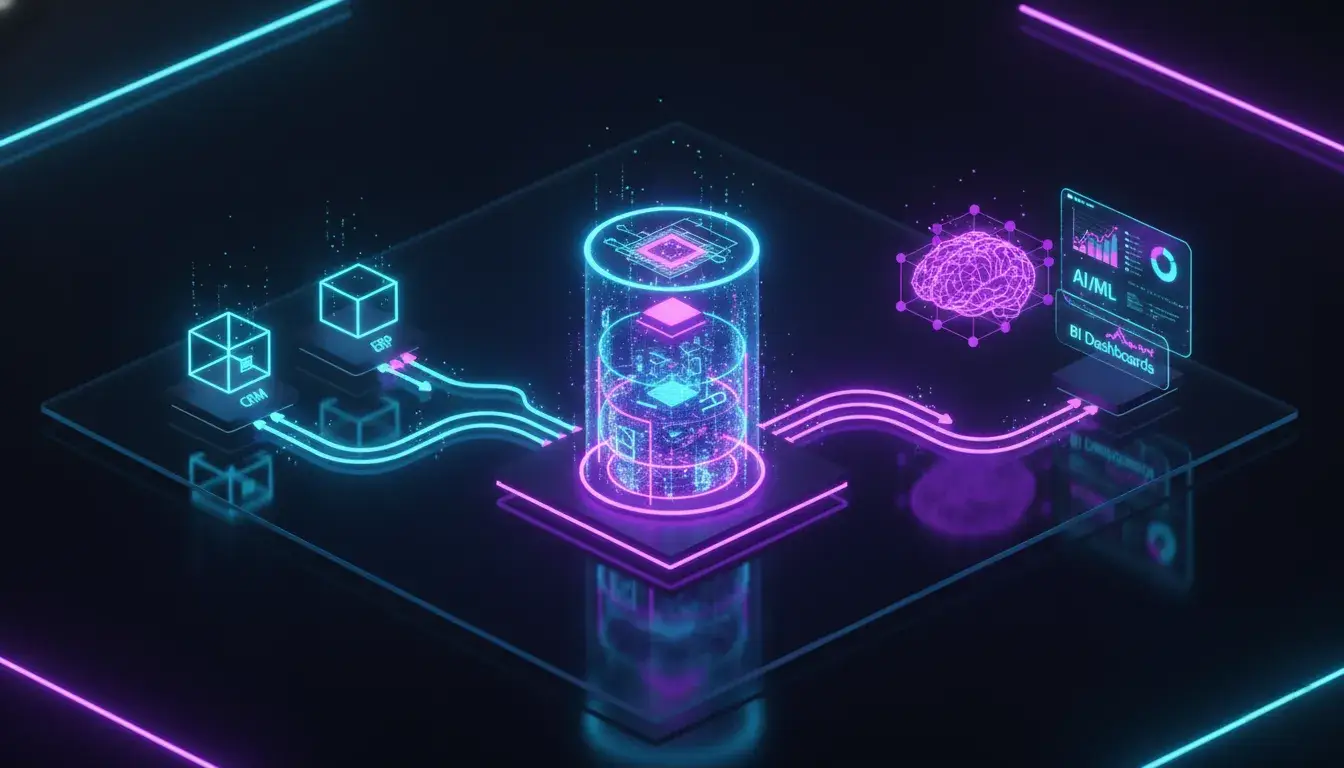

เพื่อแก้ปัญหา Data Silo องค์กรจำเป็นต้องเปลี่ยนผ่านสู่ Modern Data Stack ซึ่งเป็นสถาปัตยกรรมยุคใหม่ที่เน้นความคล่องตัว:

การทำ AI data integration ที่สมบูรณ์แบบ ต้องออกแบบการไหลของข้อมูล (Data Flow) ให้ไร้รอยต่อ:

"ใครเป็นเจ้าของข้อมูล?" คือคำถามแรกที่ต้องตอบก่อนทำ AI

การทำ Data Governance คือการกำหนดกฎเกณฑ์ว่า ข้อมูลระดับไหน (เช่น ข้อมูลบัตรเครดิต, PII - Personally Identifiable Information) ที่ ห้าม ส่งเข้าไปเทรนใน Public AI Model เด็ดขาด องค์กรต้องมีการทำ Data Masking (ปิดบังข้อมูลสำคัญ) และระบบ Access Control ที่รัดกุม เพื่อให้สอดคล้องกับพ.ร.บ. คุ้มครองข้อมูลส่วนบุคคล (PDPA)

สถาปัตยกรรมข้อมูลที่ดีต้อง "Scale ได้โดยที่ต้นทุนไม่พุ่งตามเป็นเส้นตรง" การใช้ Cloud-native Database ที่แยกส่วนประมวลผล (Compute) ออกจากส่วนจัดเก็บ (Storage) จะช่วยให้คุณจ่ายค่าประมวลผลเฉพาะตอนที่ AI กำลังรันโมเดลเท่านั้น ซึ่งช่วยควบคุมต้นทุนในระยะยาวได้อย่างมีประสิทธิภาพ

บทสรุป:

ก่อนจะถามหา AI Model ที่ฉลาดที่สุด ให้กลับมาสำรวจว่า Data Architecture ขององค์กรคุณพร้อมหรือยัง เพราะในยุค AI-First ความได้เปรียบในการแข่งขันไม่ได้อยู่ที่ "ใครมี AI เก่งกว่ากัน" แต่อยู่ที่ "ใครมี Data ที่สะอาด ถูกต้อง และเชื่อมต่อกันได้ดีกว่ากัน"